Rolling bearing fault diagnosis method based on adaptive spectral loss generative adversarial networks

-

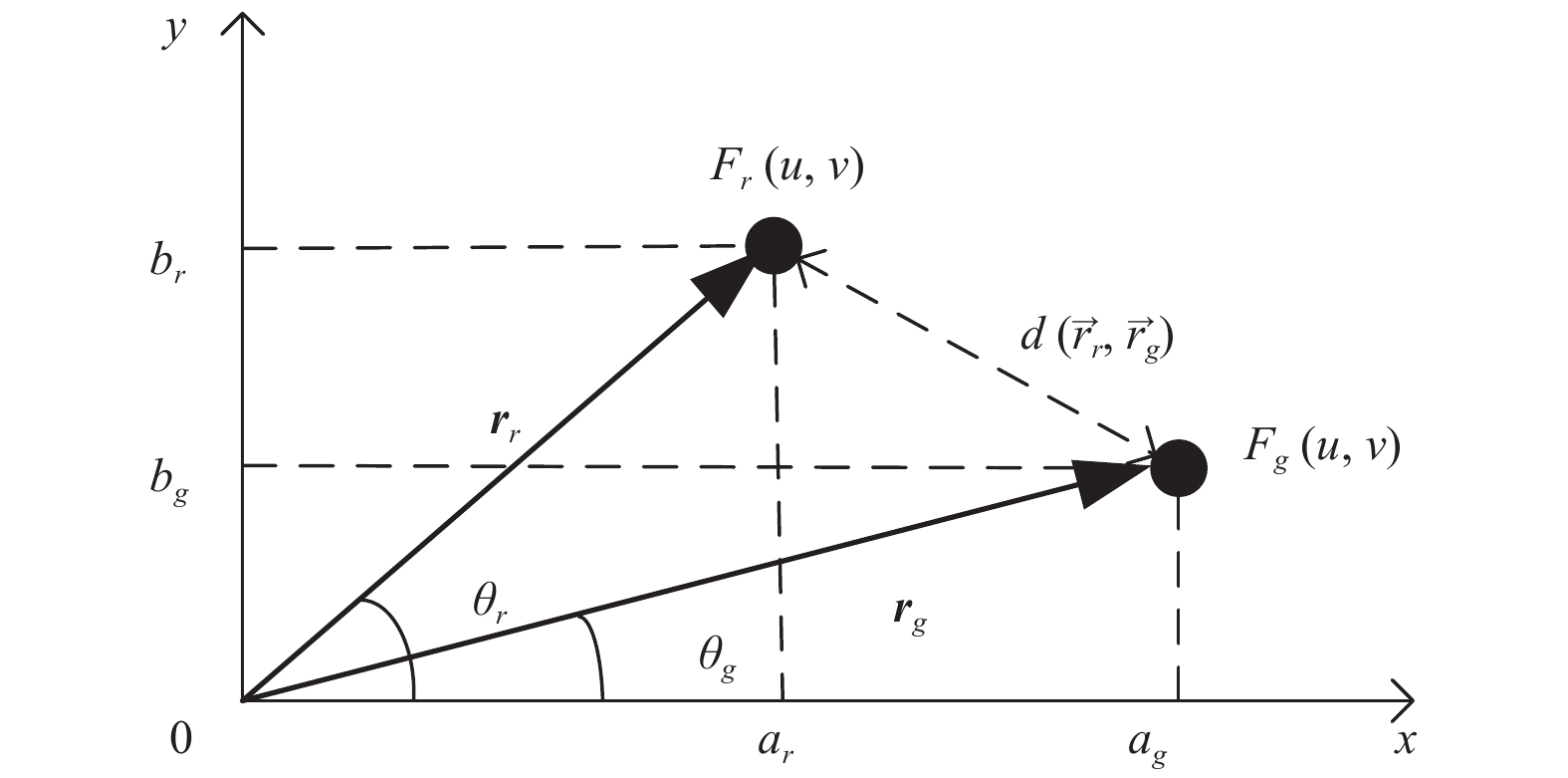

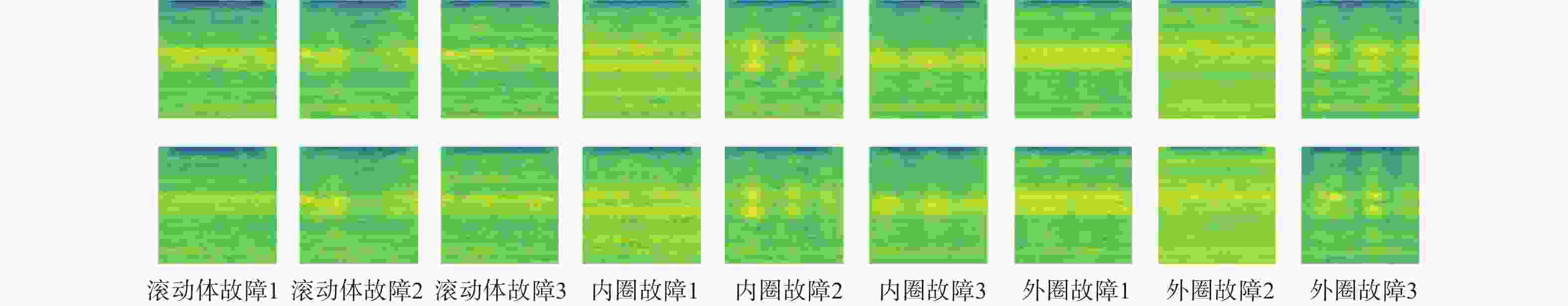

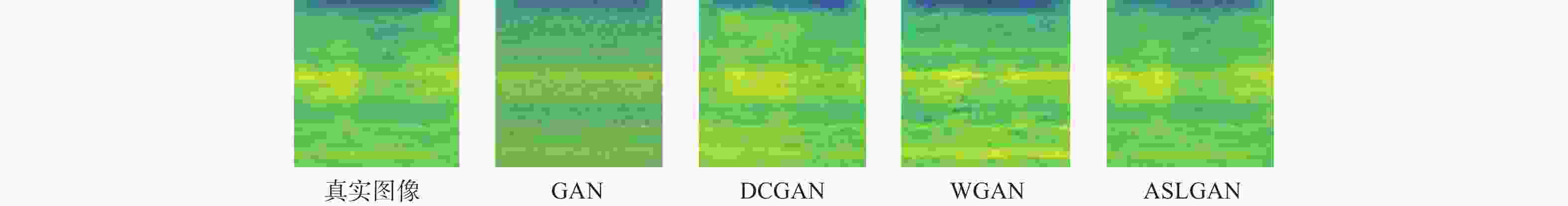

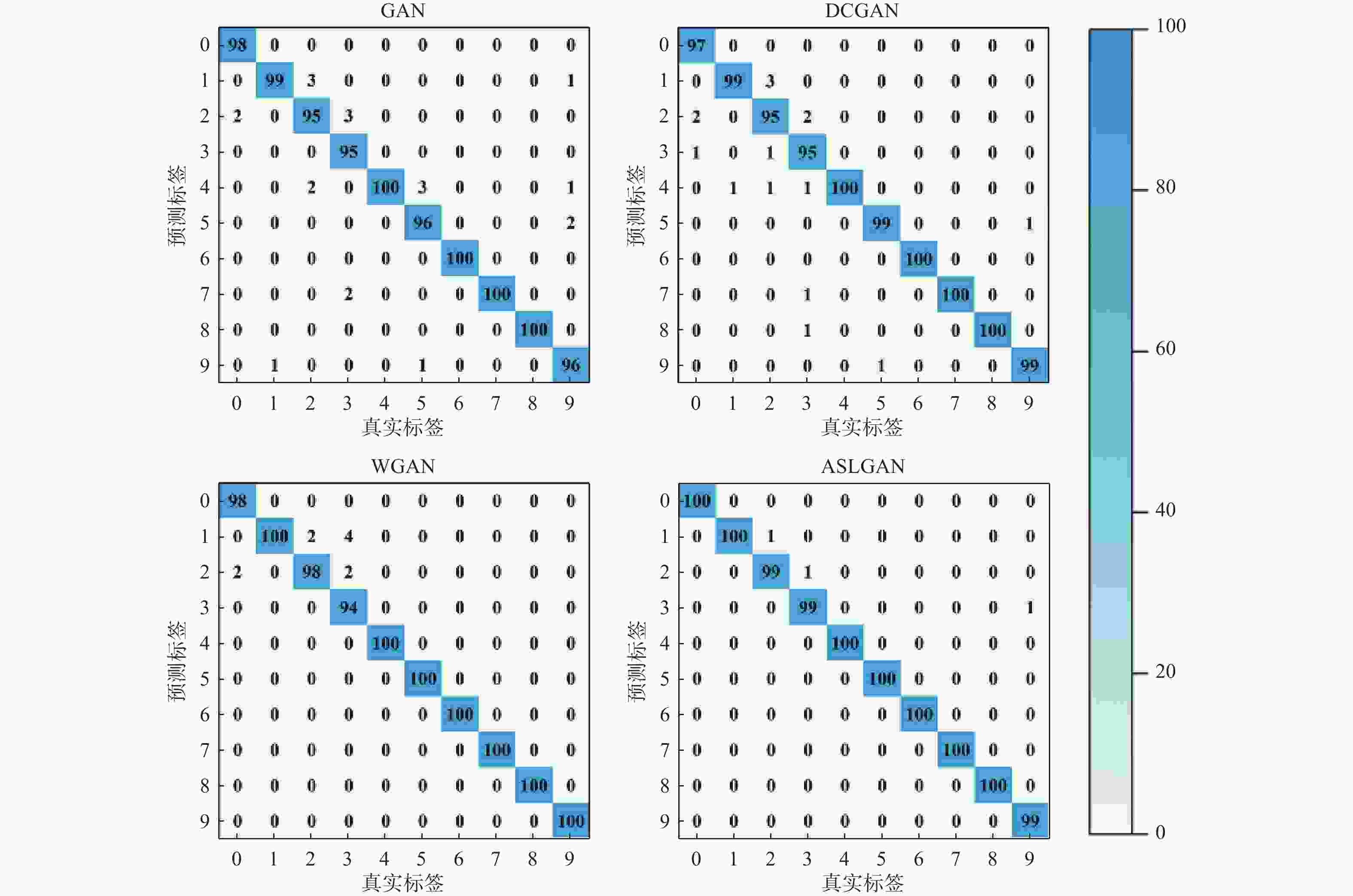

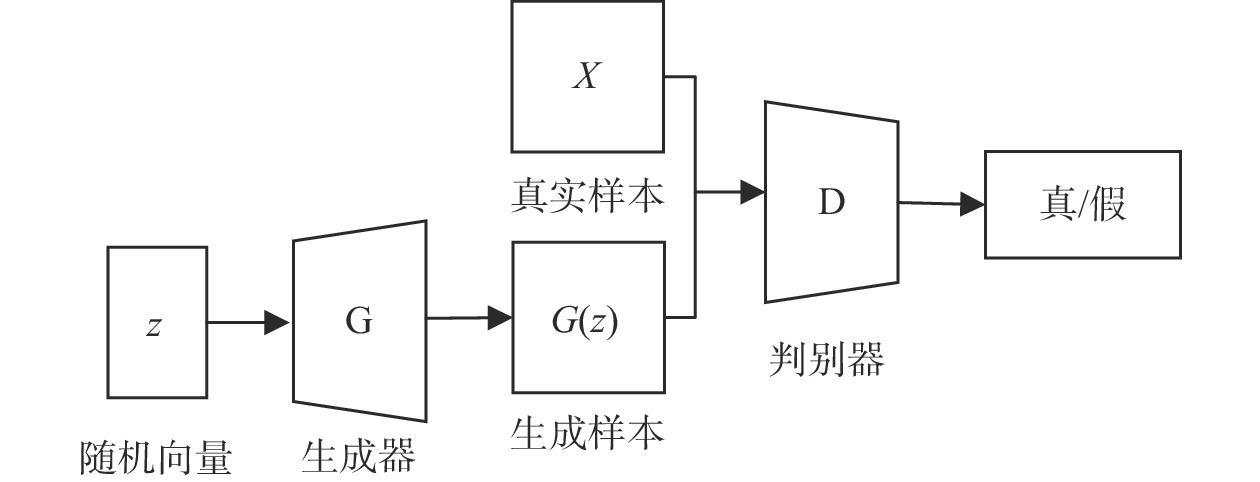

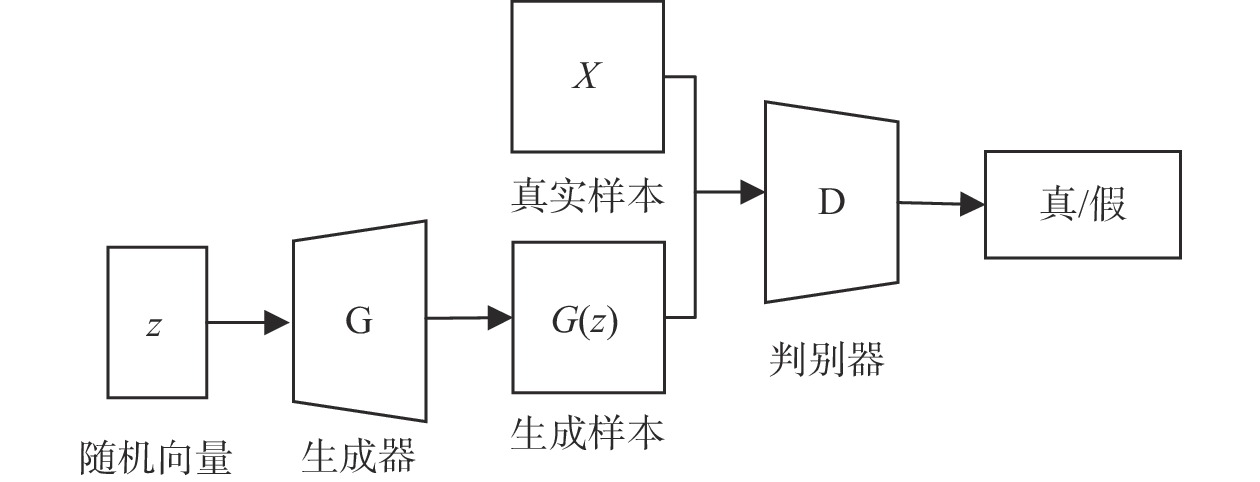

摘要: 提出一种基于自适应频谱损失生成对抗网络的轴承故障诊断方法。首先,引入谱距离度量生成数据与真实数据间的频域差距。其次,在生成器损失中加入自适应频谱损失降低简单频率分量的权重,从而自适应地关注难以合成的频率分量,以更好地指导生成对抗网络,生成与真实数据更相似的假样本。利用凯斯西储大学轴承数据集进行验证,并与其他方法相比。结果表明,自适应频谱损失生成对抗网络能生成质量更高的样本,并显著提高样本不平衡条件下的故障识别率。Abstract: A rolling bearing fault diagnosis method based on adaptive spectrum loss generative adversarial networks was proposed. Firstly, the spectral distance was introduced to measure the frequency domain difference between generated data and real data. Secondly, adaptive spectrum loss was added to the generator loss to reduce the weight of simple frequency components, so as toadaptively focus on difficult-to-synthesize frequency components, to better guide the generative adversarial networks to generate fake samples more similar to real data. The proposed method was validated using the Case Western Reserve University bearing dataset. Compared with other methods, the adaptive spectrum loss generative adversarial networks can generate higher-quality samples and significantly improve fault recognition rate under sample imbalance conditions.

-

表 1 轴承数据集详细信息

Table 1. Bearing dataset details

故障位置 故障深度/mm 样本数(训练集/测试集) 类别名称 标签 无 — 100/100 正常 0 滚动体 0.178 20/100 滚动体故障1 1 0.356 20/100 滚动体故障2 2 0.534 20/100 滚动体故障3 3 内圈 0.178 20/100 内圈故障1 4 0.356 20/100 内圈故障2 5 0.534 20/100 内圈故障3 6 外圈 0.178 20/100 外圈故障1 7 0.356 20/100 外圈故障2 8 0.534 20/100 外圈故障3 9 表 2 ASLGAN生成模型与CNN故障分类模型架构

Table 2. Architectures of ASLGAN generative model and CNN fault classification model

模型名称 模型结构组成 主要参数 输出尺寸 生成器 Input — 100 × 1 × 1 ConvTranspose_2D + BN + ReLu 100,512,4,1,0 512 × 4 × 4 ConvTranspose_2D + BN + ReLu 512,256,4,2,1 256 × 8 × 8 ConvTranspose_2D + BN + ReLu 256,128,4,2,1 128 × 16 × 16 ConvTranspose_2D + BN + ReLu 128,64,4,2,1 64 × 32 × 32 ConvTranspose_2D + Tanh 64,3,4,2,1 3 × 64 × 64 判别器 Input — 3 × 64 × 64 Conv_2D + LeakReLu 3,64,4,2,1 64 × 32 × 32 Conv_2D + BN + LeakReLu 64,128,4,2,1 128 × 16 × 16 Conv_2D + BN + LeakReLu 128,256,4,2,1 256 × 8 × 8 Conv_2D + BN + LeakReLu 256,512,4,2,1 512 × 4 × 4 Conv_2D 512,1,4,1,0 1 × 1 × 1 CNN分类器 Input — 3 × 64 × 64 Conv_2D + ReLu + MaxPool 3,16,5,1,0 16 × 60 × 60 Conv_2D + ReLu + MaxPool 16,32,5,1,0 32 × 26 × 26 Conv_2D + ReLu + MaxPool 32,64,5,1,0 64 × 9 × 9 Flatten — 1024 Linear + ReLu 1024 ,120120 Linear + ReLu 120,10 10 表 3 生成图像与真实图像的PSNR值对比结果

Table 3. Comparison results of PSNR values of generated image and real image

方法 滚动体故障 内圈故障 外圈故障 平均值 1 2 3 1 2 3 1 2 3 GAN 27.992 27.971 27.980 27.905 27.916 28.030 27.983 27.884 28.053 27.968 DCGAN 28.275 28.210 27.762 28.599 28.581 28.402 28.392 27.738 28.253 28.246 WGAN 28.772 28.612 28.776 29.448 28.709 29.144 29.355 28.726 28.629 28.908 ASLGAN 29.052 28.865 29.027 29.614 28.880 29.258 29.576 28.994 28.850 29.124 表 4 生成图像与真实图像的SSIM值对比结果

Table 4. Comparison results of SSIM values of generated image and real image

方法 滚动体故障 内圈故障 外圈故障 平均值 1 2 3 1 2 3 1 2 3 GAN 0.503 0.504 0.538 0.581 0.452 0.541 0.623 0.468 0.505 0.524 DCGAN 0.583 0.473 0.157 0.658 0.435 0.469 0.666 0.165 0.491 0.455 WGAN 0.495 0.459 0.504 0.652 0.415 0.571 0.692 0.484 0.472 0.527 ASLGAN 0.541 0.528 0.550 0.674 0.453 0.589 0.706 0.573 0.512 0.569 表 5 生成图像与真实图像的LPIPS值对比结果

Table 5. Comparison results of LPIPS values of generated image and real image

方法 滚动体故障 内圈故障 外圈故障 平均值 1 2 3 1 2 3 1 2 3 GAN 15.238 15.280 15.220 15.412 15.435 15.229 15.169 15.605 15.317 15.323 DCGAN 14.628 15.094 16.493 14.257 14.856 14.663 14.448 16.529 15.217 15.132 WGAN 14.500 14.805 14.510 13.884 14.828 14.129 14.020 14.587 14.989 14.473 ASLGAN 14.274 14.567 14.298 13.790 14.670 14.050 13.855 14.301 14.752 14.284 -

[1] FAN J G, YUAN X F, MIAO Z M, et al. Full attention Wasserstein GAN with gradient normalization for fault diagnosis under imbalanced data[J] . IEEE Transactions on Instrumentation and Measurement,2022,71:1 − 16. [2] LEI Y G, YANG B, JIANG X W, et al. Applications of machine learning to machine fault diagnosis: a review and roadmap[J] . Mechanical Systems and Signal Processing,2020,138:106587. doi: 10.1016/j.ymssp.2019.106587 [3] 郭玉荣, 茅健, 赵嫚. 基于CNN与注意力BiLSTM的轴承剩余使用寿命预测方法[J] . 上海工程技术大学学报,2023,37(1):96 − 104. [4] SHAO H D, XIA M, WAN J F, et al. Modified stacked autoencoder using adaptive morlet wavelet for intelligent fault diagnosis of rotating machinery[J] . IEEE/ASME Transactions on Mechatronics,2022,27(1):24 − 33. doi: 10.1109/TMECH.2021.3058061 [5] JIA F, LEI Y G, LIN J, et al. Deep neural networks: a promising tool for fault characteristic mining and intelligent diagnosis of rotating machinery with massive data[J] . Mechanical Systems and Signal Processing,2016,72/73:303 − 315. doi: 10.1016/j.ymssp.2015.10.025 [6] SHAO H D, JIANG H K, ZHANG H Z, et al. Rolling bearing fault feature learning using improved convolutional deep belief network with compressed sensing[J] . Mechanical Systems and Signal Processing,2018,100:743 − 765. doi: 10.1016/j.ymssp.2017.08.002 [7] ZHANG T C, CHEN J L, LI F D, et al. Intelligent fault diagnosis of machines with small & imbalanced data: a state-of-the-art review and possible extensions[J] . ISA Transactions,2022,119:152 − 171. doi: 10.1016/j.isatra.2021.02.042 [8] GOODFELLOW I J, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets[C] //Proceedings of Conference on Neural Information Processing Systems. New York: ACM, 2020: 139−144. [9] ZHANG T C, CHEN J L, LI F D, et al. A small sample focused intelligent fault diagnosis scheme of machines via multi-modules learning with gradient penalized generative adversarial networks[J] . IEEE Transactions on Industrial Electronics,2020,68(10):10130 − 10141. [10] WANG Z R, WANG J, WANG Y R. An intelligent diagnosis scheme based on generative adversarial learning deep neural networks and its application to planetary gearbox fault pattern recognition[J] . Neurocomputing,2018,310:213 − 222. doi: 10.1016/j.neucom.2018.05.024 [11] ZHOU F N, YANG S, FUJITA H, et al. Deep learning fault diagnosis method based on global optimization GAN for unbalanced data[J] . Knowledge-Based Systems,2020,187:104837. doi: 10.1016/j.knosys.2019.07.008 [12] 肖雄, 肖宇雄, 张勇军, 等. 基于二维灰度图的数据增强方法在电机轴承故障诊断的应用研究[J] . 中国电机工程学报,2021,41(2):738 − 749. [13] ZHANG L, ZHANG H, CAI G W, et al. The multiclass fault diagnosis of wind turbine bearing based on multisource signal fusion and deep learning generative model[J] . IEEE Transactions on Instrumentation and Measurement,2022,71:1 − 12. [14] LIANG P, DENG C, WU J, et al. Single and simultaneous fault diagnosis of gearbox via a semi-supervised and high-accuracy adversarial learning framework[J] . Knowledge-Based Systems,2020,198:105895. doi: 10.1016/j.knosys.2020.105895 [15] TAO H F, WANG P, CHEN Y, et al. An unsupervised fault diagnosis method for rolling bearing using STFT and generative neural networks[J] . Journal of the Franklin Institute,2020,357(11):7286 − 7307 doi: 10.1016/j.jfranklin.2020.04.024 [16] THOMAZELLA R, NASCIMENTO W L, ROBERTO P A, et al. Digital signal processing for self-vibration monitoring in grinding: A new approach based on the time-frequency analysis of vibration signals[J] . Measurement,2019,145:71 − 83. doi: 10.1016/j.measurement.2019.05.079 [17] WANG Z, BOVIK A C, SHEIKH H R, et al. Image quality assessment: from error visibility to structural similarity[J] . IEEE Transactions on Image Processing,2004,13(4):600 − 612. doi: 10.1109/TIP.2003.819861 [18] ZHANG R, ISOLA P, EFROS A A, et al. The unreasonable effectiveness of deep features as a perceptual metric[C] //Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2018: 586−595. [19] CRESWELL A, WHITE T, DUMOULIN V, et al. Generative Adversarial Networks: an overview[J] . IEEE Signal Processing Magazine,2018,35(1):53 − 65. doi: 10.1109/MSP.2017.2765202 [20] RADFORD A, METZ L, CHINTALA S. Unsupervised representation learning with deep convolutional generative adversarial networks[C] //International Conference on Learning Representations. San Juan: ICLR, 2016. [21] ARJOVSKY M, CHINTALA S, BOTTOU L. Wasserstein generative adversarial networks[C] //Proceedings of the 34th International Conference on Machine Learning. New York: ACM, 2017: 214−223. -

下载:

下载: